2 月 27 日消息,据《The Information》援引匿名消息人士报道,Meta 已与谷歌达成一项价值数十亿美元的合作协议,将租用谷歌云自研的张量处理单元(TPU),用于训练和运行其下一代大语言模型。这一合作不仅是 Meta 推动 AI 硬件供应链多元化的重要举措,也成为谷歌向 AI 芯片市场霸主英伟达发起挑战的关键一步。

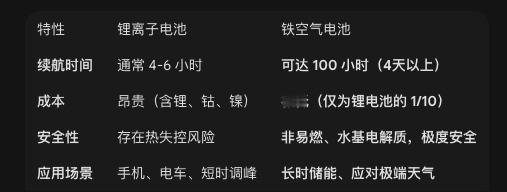

当下,全球科技巨头正为 AI 算力基础设施投入巨额资金,Meta 便是其中之一,而谷歌则看准这一市场机遇,将自研 TPU 作为云业务的核心增长引擎。目前 AI 芯片市场仍由英伟达 GPU 主导,全球绝大多数 AI 应用均基于其产品搭建,而谷歌 TPU 凭借高性价比成为颇具吸引力的替代选择,尤其在大模型训练和推理场景中优势显著。

极客网此前报道,谷歌在 2025 年 11 月推出了最新一代 Ironwood TPU,这款旗舰产品拥有极强的算力和扩展能力:单服务器集群可部署多达 9216 颗 Ironwood TPU,通过高速互连技术实现 9.6 太比特 / 秒的带宽,还能对接 1.77 拍字节的共享高带宽内存(HBM)。据谷歌官方数据,该款 TPU 的 FP8 精度百亿亿次浮点运算能力是最接近竞争对手的 118 倍,相比上一代 Trillium TPU,训练和推理性能提升 4 倍。

对 Meta 而言,与谷歌的合作是其摆脱对英伟达单一依赖的重要布局。作为英伟达的核心大客户,Meta 本月初刚宣布将在英伟达新一代 Vera Rubin GPU 今年下半年量产后,采购数百万颗该产品,而这款 GPU 目前已完成样品交付,进入量产筹备阶段。但 Meta 显然不愿将算力命脉系于单一供应商,本周早些时候,其还与英伟达的主要竞争对手 AMD 达成了数十亿美元的 AI 芯片采购协议,将购入包括最新 Instinct MI400 系列在内的多款产品。此外,Meta 还获得了认购 AMD 10% 股份的期权,若双方合作达到预定性能目标,该期权将正式生效。

分析认为,Meta 的供应链多元化布局有着明确的商业逻辑,因为不同类型的 AI 处理器各有优劣,可针对不同的 AI 工作负载实现最优搭配;同时,通过引入多家芯片供应商的竞争,Meta 能在算力基础设施建设中争取更优惠的价格,进一步降低 AI 研发成本。

而谷歌则希望借助此次合作,打破英伟达在 AI 芯片市场的垄断格局。此前,谷歌 TPU 仅通过谷歌云平台以租用形式向客户开放,如今其计划改变商业模式,直接向客户销售芯片,让企业可在自有私有数据中心部署。谷歌预计,这一策略有望在未来几年抢占英伟达数据中心业务 10% 的营收份额。

据悉,Meta 目前还在与谷歌洽谈另一项独立合作,计划为自有数据中心采购数百万颗 TPU,不过双方目前尚未达成最终协议。

值得关注的是,此次与谷歌的合作,也让外界对 Meta 的自研芯片计划产生更多关注。Meta 的自研训练和推理加速器(MTIA)芯片上一次更新是在 2024 年,其原本计划与台积电合作开发新一代产品,并于 2026 年推出,这款芯片针对初代产品薄弱的 AI 模型训练能力进行了优化,但据悉因遭遇技术难题,量产计划已被迫推迟。

事实上,Meta 的自研芯片之路本就波折不断,其先后放弃了 Iris、Olympus 两款自研训练芯片的研发,核心原因在于芯片软件稳定性不足、设计复杂难以规模化生产,在与 OpenAI、谷歌的大模型竞争中,自研芯片的风险让其选择暂时转向外部采购。