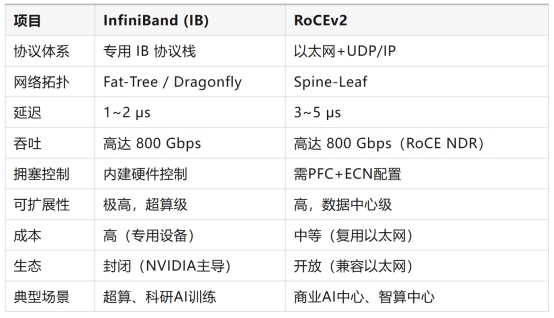

随着AI大模型迈入万亿参数时代,算力集群从千卡向万卡乃至十万卡规模演进,网络互连已成为决定训练效率的关键瓶颈。RDMA(远程直接内存访问)技术通过绕过CPU、实现内存直通,为智算中心提供了超低延迟、高带宽的数据传输能力。当前,主流的RDMA实现路径分为两大体系:InfiniBand(IB)与RoCE(RDMA over Converged Ethernet)。二者均以RDMA为核心,却在架构设计、性能表现与适用场景上存在本质差异。

一、InfiniBand(IB)网络

技术概述

InfiniBand 是一种专为高性能计算设计的原生RDMA网络,拥有独立的协议栈和专用交换芯片。它从物理层到传输层均为无损网络而生,通过硬件级的信用流控机制,确保数据在传输过程中绝不丢包。

关键特性

专用硬件:采用InfiniBand交换机与HCA(主机通道适配器),非以太网生态。

信用流控:基于信用的链路层流控,从源头避免缓冲区溢出,实现真正无损。

集中管理:由子网管理器(SM)统一配置路由与转发,网络状态全局可控。

极低延迟:交换机直通转发,延迟低至100ns级,端到端延迟可稳定在1-2μs。

优点

✅ 性能极致:400G/800G(NDR)带宽,可支撑十万节点级超大规模集群。

✅ 无损可靠:内建拥塞控制和链路级重传,训练任务无需担忧丢包。

✅ 即插即用:配置简单,开箱即用,无需繁琐调优。

缺点

❌ 成本高昂:专用设备与线缆价格远超以太网方案。

❌ 供应商锁定:主要由NVIDIA/Mellanox垄断,国产供应链缺失。

二、RoCE(RDMA over Converged Ethernet)网络

技术概述

RoCE 旨在标准以太网上实现RDMA,v2版本基于UDP/IP封装,使其可路由、可跨网段通信。它通过引入PFC(优先级流控)、ECN(显式拥塞通知)等机制,在传统有损以太网上营造无损环境。

关键特性

以太网兼容:复用现有交换机与网卡,降低硬件采购成本。

无损补丁:依赖PFC、ECN、DCQCN等技术防止丢包,需精细调参。

三层路由:RoCEv2支持跨子网通信,适配数据中心网络架构。

优点

✅ 成本亲民:采用标准以太网设备,总体拥有成本较低。

✅ 灵活扩展:可与IP网络共存,适合混合负载的云数据中心。

✅ 供应链多元:避免单一供应商依赖,国产厂商已大量布局。

缺点

❌ 配置复杂:PFC死锁、ECN水线调整高度依赖运维经验,易出故障。

❌ 延迟稍高:交换机需存储转发,延迟300-500ns,端到端3-5μs。

❌ 扩展受限:跨POD通信性能衰减明显,通常不推荐万卡以上规模。

三、国产突破:原生IB赛道崛起

IB与RoCE并非简单的替代关系,而是智算网络不同场景下的理性选择。RoCE凭借成本与生态优势,将在中小规模及混合负载场景持续占据一席之地;而IB凭借极致性能,始终是顶级超算与万卡级AI集群的“皇冠明珠”。

长期以来,国内厂商多聚焦于RoCE优化,试图通过软件调优弥合与IB的性能鸿沟。然而,RoCE基于以太网的先天缺陷使其在超大规模集群中难以匹敌IB的原生无损优势。真正的RDMA无法被“模拟”,唯有从底层架构重构,才能突破天花板。

近期外网爆料引发广泛关注,据悉,中国科技巨头正在构建基于InfiniBand的专有RDMA技术,直接挑战英伟达在互连技术领域的主导地位。

国产原生IB的突破,标志着中国首次拥有从芯片到系统的完整无损网络能力,有望打破海外垄断,补齐智算产业链的关键一环。正如知情人士所言,当向中国销售高端GPU的难度日益增加之时,国产互连技术的崛起,正在为自主AI算力底座铺就一条坚实的道路。