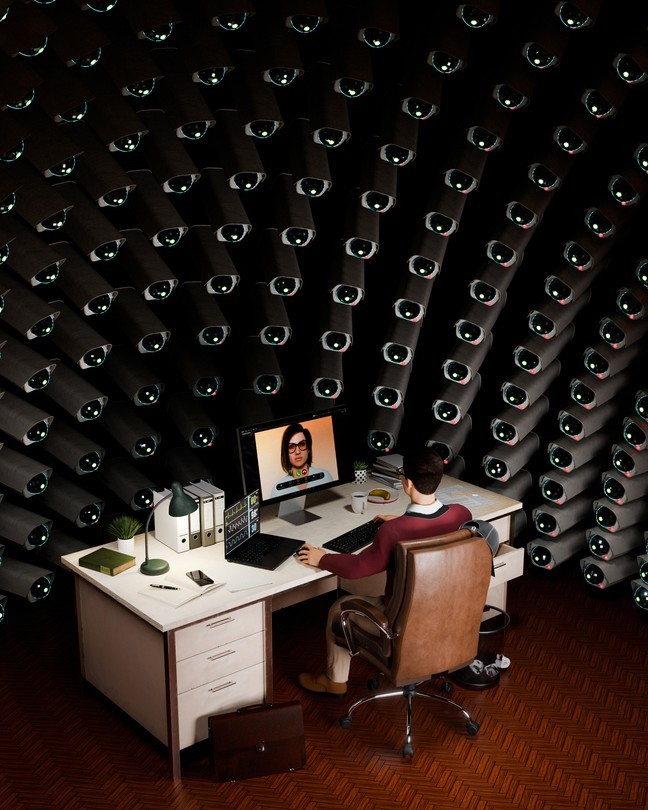

如果你的老板用 AI 监控你每天上班时的情绪,以此判断你的工作状态,你会同意吗?

『大西洋月刊』发了篇特稿,谈到了目前职场中越来越普及的 Emotion AI(情绪 AI)问题。

所谓情绪 AI,也叫情感计算,核心卖点是把人的表情、声音、文字、身体信号转成可量化指标。

它可以分析监控、在线会议视频,也可以通过音频识别音高、语调和用词,还可以扫描文档、邮件、聊天记录,最后生成专业的员工情绪报告。

从报告中,雇主可以判断员工是否在好好上班,有没有达到工作要求,或者热不热爱自己的工作。

现在,情绪 AI 商业化最成熟的地方,是客服、物流、快餐这些本来就被高度管理的岗位。

常见的就是企业监测客服的音高和语调,判定他们的工作态度;卡车运输公司使用眼球追踪器、录音设备,甚至脑波扫描仪来识别司机压力或疲劳;汉堡王正试点一个耳机 AI 聊天机器人,用来评估员工与点单顾客的互动是否友好。

作家 Cory Doctorow 在 2022 年提出过一个说法:糟糕技术往往先被用在低薪、处境不稳定的人身上,等它被改进、包装、正常化之后,再一层层推向更有议价能力的人群。

没错,现在已经轮到白领们大规模遭殃了。

Slack 的集成工具 Aware 宣称可以持续监测消息里的情绪;微软 Azure 也允许雇主批量分析员工聊天信息;MorphCast 的 Zoom 扩展能实时追踪会议参与者的注意力、兴奋度和积极性。

情绪 AI 公司 Imentiv 甚至建议把情绪分析用于招聘面试,向雇主提供候选人的情绪参与度、情绪强度、情绪效价和人格类型分析。

已经有多家人力资源公司把员工调查接入情绪分析 AI,做隔音舱的 Framery 还测试过在椅子里加入生物传感器,测心率、呼吸频率和紧张程度,它的客户就包括微软、欧莱雅这样的跨国企业。

欧盟已经意识到这件事的危险,去年禁止在工作场所使用情绪 AI 技术。

监管在收紧,市场却在膨胀。有估算认为,全球情绪 AI 市场到 2030 年会增长到 90 亿美元,约为现在的三倍。

康奈尔信息科学副教授 Karen Levy 认为,原因在于管理者真的迫切希望掌握员工动向。且美国法律允许雇主监控员工在公司时间、公司财产和公司设备上的行为,包括扫描通信、录制视频和音频。

《纽约时报》2022 年调查发现,美国十大私营雇主中有八家追踪个体员工生产率,37% 的雇主曾使用保存下来的录音解雇员工。

过去几十年,企业监控员工的主要障碍其实是成本问题。

公司当然可以收集信息,但要分析海量数据并不容易。现在 AI 闪亮登场,无论多么大的数据量,都给你瞬间完成分析。甚至可以结合位置追踪器、按键记录器、摄像头、麦克风等数据,提供分钟级的洞察。

相关公司宣称:员工没有任何一句话、任何一次停顿、任何一次情绪波动会被 AI 漏掉。

卖情绪 AI 技术的公司当然不会诚实表露自己在干啥。它们会说这是为了员工安全、心理健康、组织效率,或者在医疗、交通等高风险行业减少职业倦怠。

比如 First Horizon Bank 就用 AI 监测呼叫中心员工压力,当系统判断压力过高时,给员工展示家人照片。

虽然这个案例挺扯的,但是至少显得是在“关怀”员工。可是这些“善意出发点”掩盖不了这项技术实践中的巨大问题。

第一是 AI 的分析能力有限,且常常会有幻觉。此前媒体就披露过,UnitedHealth Group 一款用于监测效率、辅助设定薪酬的程序,会因为键盘不活跃扣减社工评分。但这些社工离线不是在摸鱼,而是在给患者做咨询。

第二是 AI 会复制训练数据中的偏见。Lauren Rhue 在 2018 年研究 NBA 球员照片和情绪识别 AI 时发现,这类技术会把黑人球员判断得比白人队友更愤怒,有时甚至在黑人球员微笑时也这么判断。

最大的问题是,很多情绪 AI 建立在一个争议很大的心理学基础上:Paul Ekman 的基本情绪理论。这个理论认为,人类普遍体验愤怒、厌恶、恐惧、快乐、悲伤和惊讶六种核心情绪。

但过去几十年,这套理论一直被批评过于简化,研究方法也存在缺陷。

神经科学家、心理学家 Lisa Feldman Barrett 就认为,人的面部、身体动作或语调并没有固定的内在情绪含义,它们的意义取决于对话语境、个人面相、文化背景、室温和现场氛围。

在情绪问题上,人类的差异才是常态,情绪根本不可能被客观测量或分析。

她给过一个非常具体的数据:在美国,人们愤怒时大约只有 35% 的时间会皱眉。反过来,人们皱眉时,有一半时间根本不是在表达愤怒。

求职面试里,一个候选人可能因为认真倾听而皱眉,AI 却把他标记为愤怒,于是他失去工作机会;医院呼叫中心员工在和患者谈论病情时因悲伤而皱眉,系统可能判断她不够温暖、不够开朗;快餐员工认真听顾客点单时过于认真而皱眉,也可能被认为对顾客甩脸色。

这类误判一旦接入职场监控,就会直接导致工资、晋升、解雇和机会的损失。

当然,推广情绪 AI 的公司和购买方会有另一套说法:人类管理者同样有偏见,算法至少能揭示单靠印象无法发现的模式,AI 也会从错误中学习,未来会变得更好。

但,即便情绪 AI 有一天真的变准了,职场就应该拥有这项权力吗?

如果 AI 真能看出你焦虑、疲惫、愤怒、敷衍、厌倦,那员工除了做好本职工作,还得让情绪机器人相信自己足够快乐、积极、顺从,每天都要刻意在 AI 前表演出自己对工作极大的热爱。

更别提这其中还有强烈的尊严问题。

文章中最后一句话写得很好:计算机若能喜欢我,我受宠若惊。但我更希望,它对我一无所知(I am flattered the computer liked me, but I’d prefer it didn’t know me at all)。