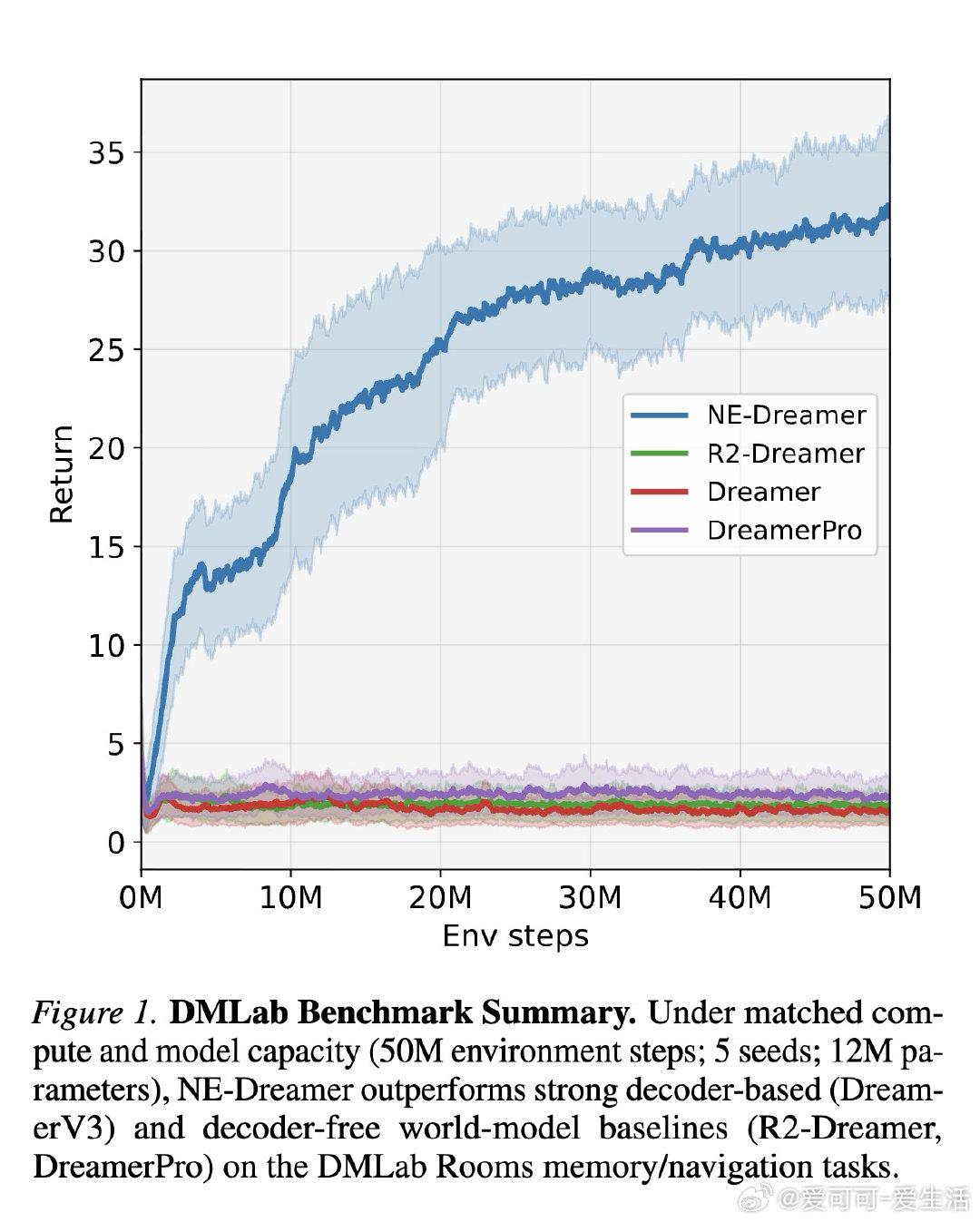

[LG]《Next Embedding Prediction Makes World Models Stronger》G Bredis, N Balagansky, D Gavrilov, R Rakhimov [T-Tech] (2026)

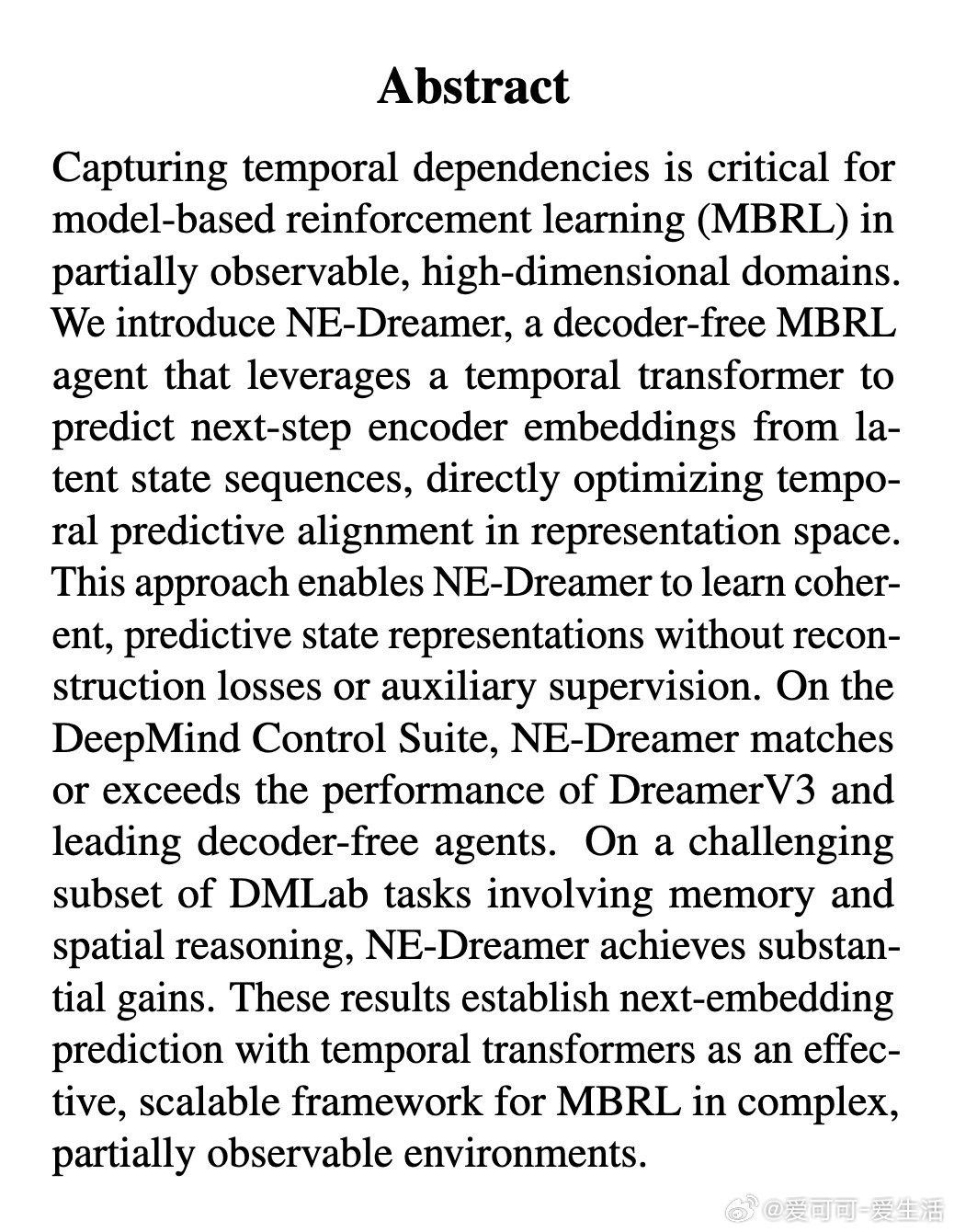

在部分可观测的强化学习领域,如何让智能体跨时间步维持连贯的状态记忆,是一个悬而未决的难题。过去的方法受困于像素重建目标或同时刻对齐约束,本质原因是这些信号只锚定当前帧,无法迫使潜在状态对"下一刻将发生什么"形成真实预测力。

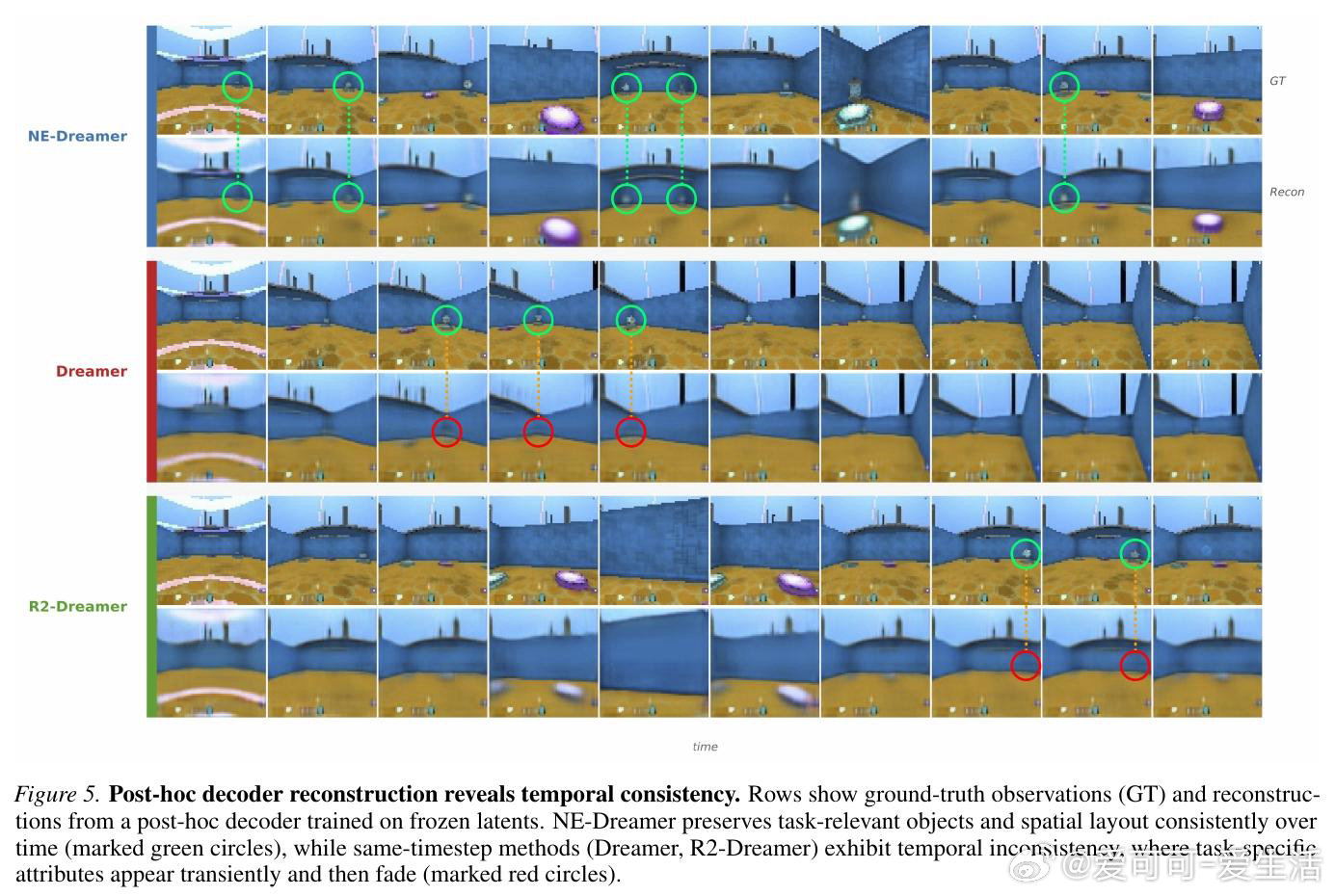

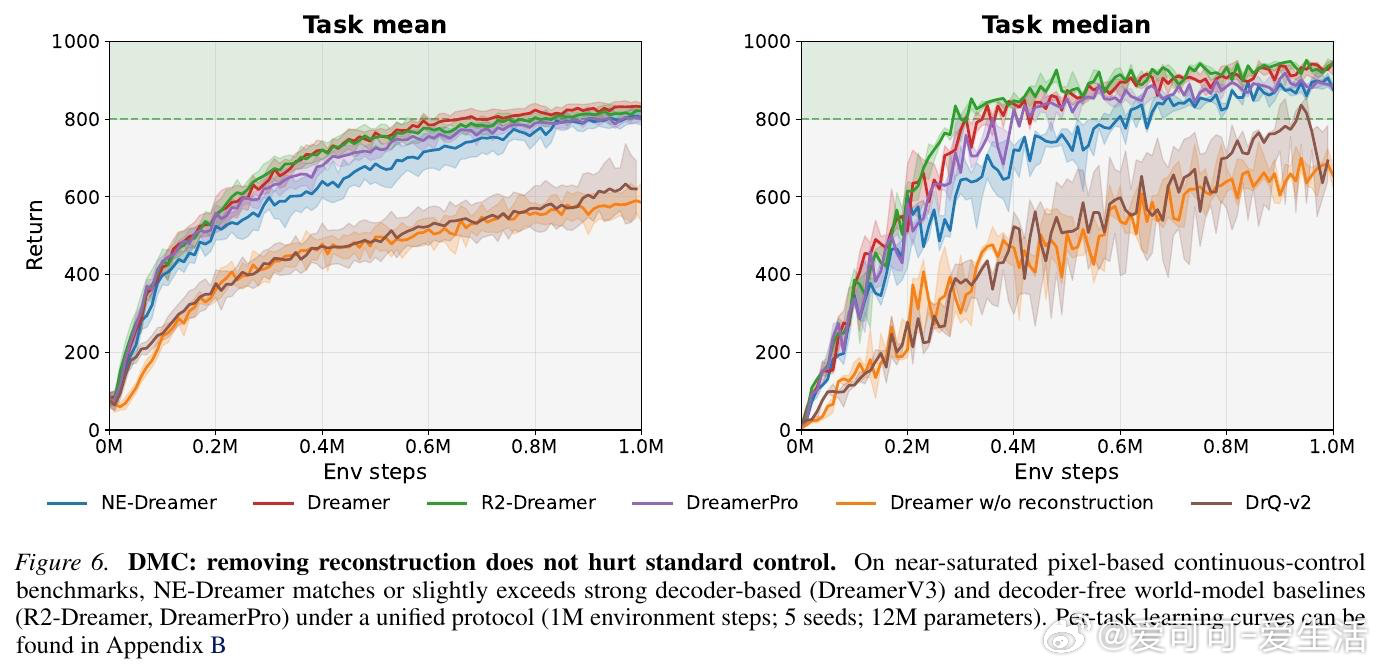

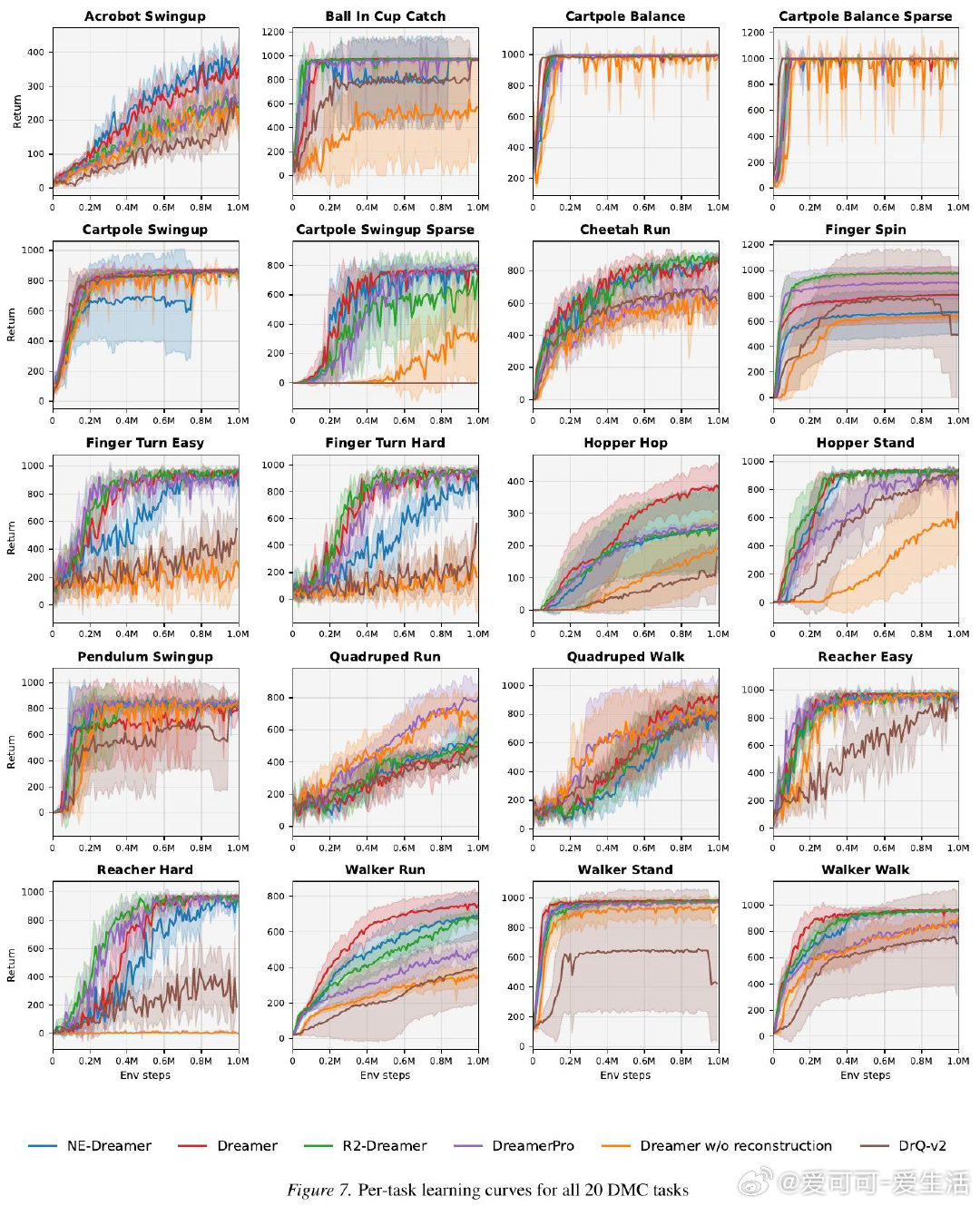

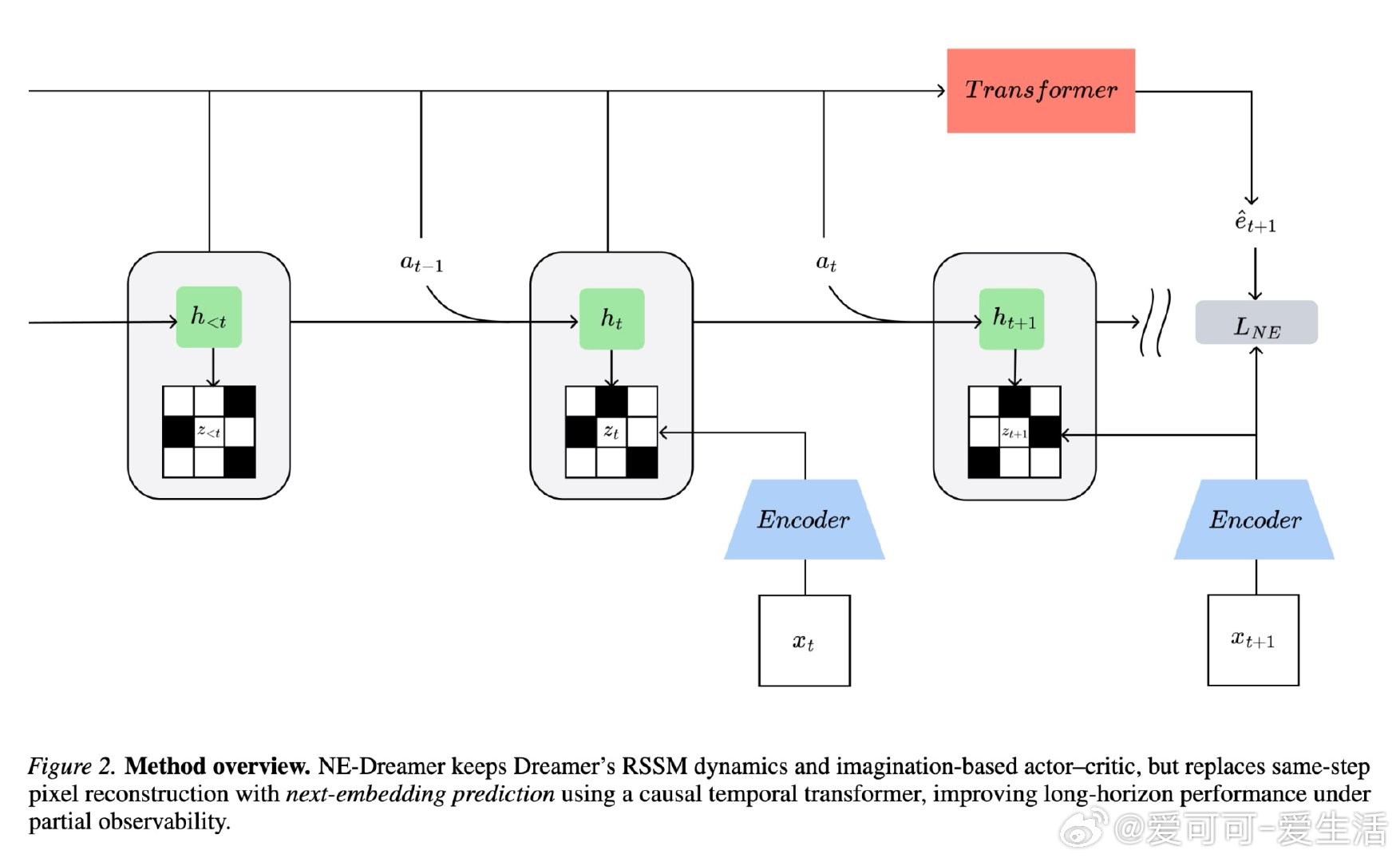

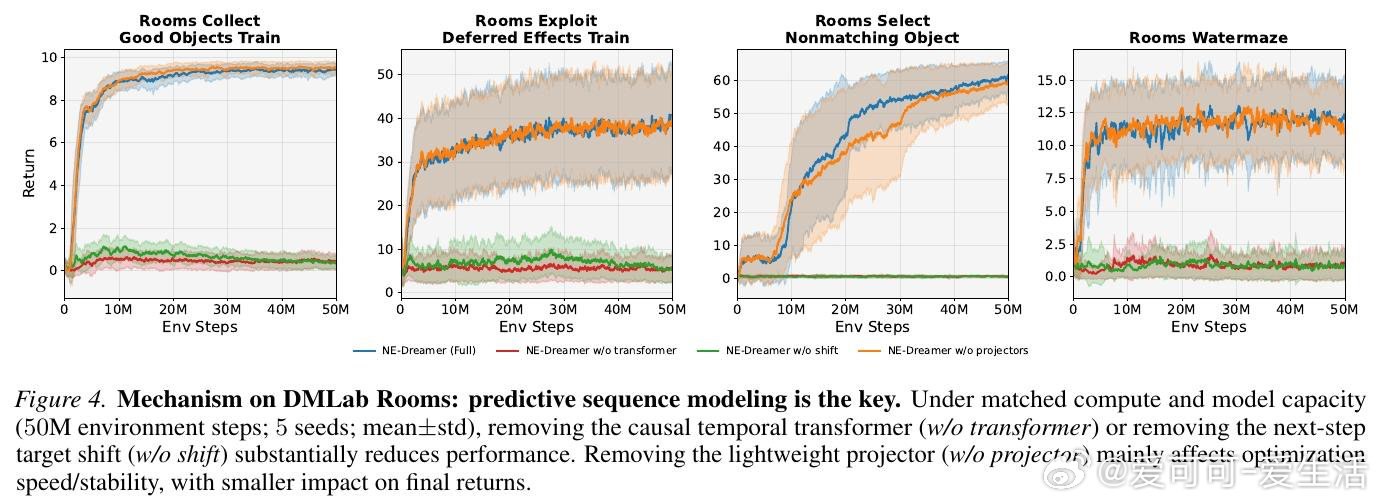

本文的核心洞见是:把表示学习重新看作时序因果预测任务,而非重建或当帧匹配。由此,用因果时序Transformer预测下一步编码器嵌入、并以Barlow Twins损失对齐停梯度目标,这一关键操作使世界模型被迫在潜空间中保留跨时间步的预测性结构,记忆与导航任务的性能得以大幅突破。

这项工作真正留下的遗产是:无解码器世界模型不必依赖像素重建也能获得丰富的时序表示。它为后来者打开的新门是:将自监督的下一步预测范式系统地迁入强化学习的潜动力学框架。但尚未跨过的门槛是:该方法在高保真视觉细节至关重要的场景(如纹理、精细外观差异驱动奖励的任务)中是否依然有效,仍是开放问题。

arxiv.org/abs/2603.02765

机器学习 人工智能 论文 AI创造营